Robots.txt

Definícia

Súbor robots.txt informuje robotov vyhľadávacieho nástroja (napr. Googlebot) a crawl programy (napr. Screaming Frog) o tom, ktoré webové stránky alebo súbory môžu alebo nemôžu prechádzať.

Popis

Súbor robots.txt je súčasťou protokolu o vylúčení robotov (REP), skupiny webových štandardov, ktoré regulujú, ako roboty prehľadávajú web, pristupujú k obsahu, indexujú ho a poskytujú tento obsah používateľom. REP tiež obsahuje smernice, ako sú meta roboty, ako aj pokyny pre celú stránku, podadresár alebo lokalitu, ako by mali vyhľadávacie nástroje zaobchádzať s odkazmi (napríklad „follow“ alebo „nofollow“).

V praxi súbory robots.txt indikujú, či určití používateľskí agenti (softvér na prehľadávanie webu) môžu alebo nemôžu prehľadávať časti webovej lokality. Tieto pokyny na prehľadávanie sú špecifikované zakázaním alebo povolením správania určitých (alebo všetkých) používateľských agentov.

Ako funguje súbor robots.txt?

Pri prehliadaní stránok boti sledujú odkazy, aby sa dostali z jednej stránky na druhú – v konečnom dôsledku prehľadávajú mnoho miliárd odkazov a webových stránok. Toto správanie pri indexovom prehľadávaní je niekedy známe ako „pavúk“.

Po príchode na webovú stránku, ale pred jej „spideringom”, vyhľadávací prehľadávač vyhľadá súbor robots.txt v koreňovom adresári (napr. https://www.nazovstranky.com/robots.txt). Ak ho nájde, prečíta jeho obsah a až potom rozhodne o ďalších krokoch prehľadávania. Pretože súbor robots.txt obsahuje informácie o tom, ako by mal vyhľadávací nástroj prehľadávať, informácie, ktoré sa v ňom nachádzajú, povedú k ďalšej činnosti prehľadávača na tejto konkrétnej lokalite.

Ak súbor robots.txt neobsahuje žiadne príkazy, ktoré zakazujú činnosť používateľského agenta (alebo ak stránka nemá súbor robots.txt), bude pokračovať v prehľadávaní ďalších informácií na stránke.

Štruktúra súboru robots.txt

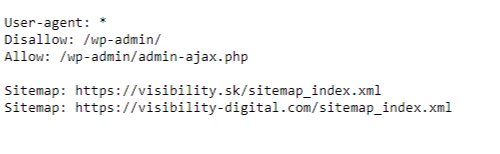

Súbor robots.txt je jednoduchý textový súbor, ktorý obsahuje pokyny pre robotov vo forme direktív. Typická syntax obsahuje:

- User-agent – určuje, ktorému botu sú určené pravidlá (napr. Googlebot).

- Disallow – zakazuje prehľadávanie určitej časti webovej stránky.

- Allow – povoľuje prístup do špecifických častí webu, aj keď nadradená zložka je zakázaná.

- Sitemap – odkazuje na sitemap.xml súbor, ktorý pomáha robotom lepšie indexovať stránku.

Aj keď súbor robots.txt poskytuje smernice pre roboty, nie je to bezpečnostná ochrana. Niektoré roboty môžu tieto pravidlá ignorovať a aj napriek zákazu obsah prehľadať a indexovať. Preto sa robots.txt neodporúča na ochranu citlivých údajov – na tento účel je vhodnejšie použiť heslovú ochranu alebo serverové nastavenia (napr. .htaccess).

Význam robots.txt pre SEO

Správna konfigurácia robots.txt môže pomôcť pri optimalizácii stránky pre vyhľadávače. Medzi hlavné výhody patrí:

Kontrola indexácie – Môžeme rozhodnúť, ktoré časti webu budú indexované.

Riadenie crawl budgetu – Vyhľadávače majú obmedzený crawl budget, čo znamená, že za určitý čas dokážu prehľadať len istý počet stránok. Ak sú roboty nasmerované iba na dôležité časti webu, efektívne sa využije ich kapacita.

Zlepšenie výkonu stránky – Zakázaním prehľadávania nepodstatných súborov (napr. wp-admin) môžeme znížiť zaťaženie servera a zrýchliť načítanie stránky.

Príklad

Ukážka zápisu robots.txt na stránke visibility.sk